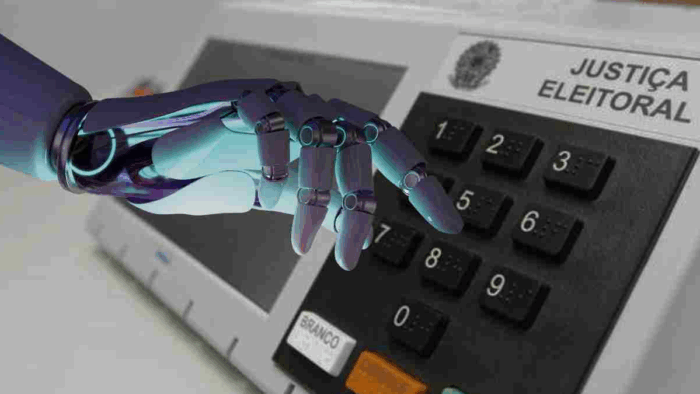

Eleições gerais de 2026 sob o império da IA (I)

Lembra da bolinha de papel que atingiu José Serra? Lembra do “gabinete do ódio” tentando comprar software de monitoramento? Aquilo era pirulito no recreio: improviso, ruído, truque de esquina. A guerra de 2026 é outra. Ela não depende de um ato que vira manchete — depende de um encanamento que roda todo dia. Não precisa que você acredite; basta que você duvide. Não precisa vencer o argumento; basta saturar a atenção.

As eleições gerais de 2026 começam assim: não com uma mentira monumental, mas com uma avalanche de pequenas certezas prontas para consumo. Na primeira hora da manhã, antes do café terminar de coar, o país já está de pé — não pelas ruas, mas pela palma da mão.

O celular vibra com a urgência de quem bate na porta. Um vídeo chega no grupo da família. Em seguida, o mesmo vídeo aparece em outro, com uma legenda diferente. Depois, numa terceira versão, alguém “explica” a cena com uma voz segura, paternal, como se estivesse revelando um segredo que só ele teve coragem de dizer em voz alta.

Dez minutos depois, o assunto vira meme. Em meia hora, vira “tendência”. Em uma hora, você já encontra gente reagindo ao vídeo que você ainda nem viu — e gente reagindo à reação do vídeo que você nem teve tempo de checar.

É isso — em escala — que já está acontecendo. Não é que a desinformação tenha nascido agora. O que mudou foi o patamar. O que antes exigia equipe, tempo, orçamento e uma estrutura quase industrial, hoje pode ser feito como se fosse um aplicativo: liga, produz, adapta, dispara. A inteligência artificial entra como quem abaixa o preço do ingresso para um estádio lotado. Ela não inventa a torcida, mas faz a multidão chegar mais rápido — e gritar em coro.

A eleição geral de 2026 deixa de ser apenas a disputa clássica das ideias. Vira algo mais frio e mais difícil de explicar em frases bonitas: uma disputa de infraestrutura. Infraestrutura de atenção, distribuição e velocidade. Quem controla o encanamento por onde as emoções passam.

O método exposto

No começo do ano, uma história atravessou Brasília e as redes com um detalhe que importa mais do que o enredo: o método. Reportagens registraram relatos de influenciadores abordados no fim de 2025 com propostas para publicar conteúdos questionando decisões do Banco Central do Brasil no caso Banco Master.

A peça central, aqui, não é o valor exato nem o folclore da negociação — é a lógica: conteúdo sob encomenda, roteiro, timing, multiplicação. Quando o assunto ganhou corpo, a Polícia Federal abriu apuração para investigar uma possível campanha coordenada nas redes contra o Banco Central após a liquidação do banco, segundo noticiário.

Em paralelo, análises públicas de pesquisadores indicaram volume elevado de publicações e a tentativa de dar aparência de “onda espontânea” ao que poderia ser uma operação organizada — um traço típico do nosso tempo: não basta falar; é preciso parecer inevitável.

Esse episódio funciona como um ensaio geral por um motivo simples: ele mostra que redes capazes de operar hoje para um pagador podem operar amanhã para outro — e, num ano eleitoral, essa plasticidade deixa de ser detalhe de mercado e vira risco institucional.

A política sempre se alimentou de fatos — mas em 2026 os fatos não são mais o centro; são matéria-prima. Um recorte. Um pedaço de áudio. Uma frase fora de contexto. Um gráfico sem fonte. Um print sem link. Um “vazamento” sem origem. Um vídeo editado para caber em 30 segundos e sobrar indignação.

A IA não precisa fabricar tudo do zero. Ela pode fazer algo mais eficiente: torcer o real até que o real pareça outra coisa. O falso raramente chega com a placa “falso”. Ele chega com maquiagem, com luz boa e com uma legenda certeira. E quando o conteúdo parece testemunho, a checagem vira uma corrida injusta — porque a checagem exige o que o conteúdo não oferece: origem, contexto, cadeia. A checagem precisa de tempo; a emoção precisa de segundos.

A fábrica do espontâneo

A grande operação do nosso tempo não é convencer — é parecer natural.

Parece um depoimento, mas é um roteiro. Parece indignação, mas é um pacote. Parece “voz do povo”, mas tem cronograma. Parece “achei isso por acaso”, mas há uma máquina inteira empurrando o acaso para a sua tela.

A estética é a do cotidiano. O cenário é a sala simples, o carro parado, a rua. O vocabulário imita o de quem não tem tempo para discurso: “vou falar rápido”, “não dá pra ficar calado”, “ninguém quer te contar isso”. A frase final pede um gesto que parece inofensivo — “manda pra mais alguém” — mas é o empurrão que transforma um conteúdo em corrente.

E aí entra o traço novo: em 2026, a máquina que produz essas peças não precisa mais de tanto esforço humano para variar. A IA escreve uma versão “irônica” e outra “grave”. Uma mais regional, outra mais “neutra”. Uma com cara de “análise”, outra com cara de “desabafo”. Ela faz o que o marqueteiro de ontem chamaria de segmentação — só que com uma rapidez que deixaria qualquer agência antiga com inveja.

O milagre é simples: a mesma mensagem, com roupas diferentes, entra em casas diferentes sem parecer propaganda. Ela entra como conversa.

Aqui está o coração do problema: a IA dá ao mercado da atenção duas vantagens que, juntas, viram um motor de guerra política. A primeira é velocidade. Um acontecimento do dia vira, em poucas horas, dezenas de versões. A segunda é variedade. A mesma ideia ganha cara de piada, de denúncia, de “análise”, de “confissão”, de “desabafo”.

Esse par — velocidade e variedade — cria um fenômeno clássico do nosso tempo: a sensação de que “está em todo lugar”. E quando algo está em todo lugar, o cérebro interpreta como verdade social, mesmo quando não é verdade factual. A etiqueta cola antes da prova.

A parte desconfortável começa aqui: se existe um mercado que vende atenção, e se esse mercado se organiza pela lógica de “entrega” (alcance, engajamento, viralidade), o Estado corre o risco de ser capturado pela arena que deveria administrar. Não se trata de demonizar criadores de conteúdo. Trata-se de reconhecer uma assimetria: sem padrões claros, contratar alcance é contratar poder de agenda. E poder de agenda, em ano eleitoral, não pode operar como caixa-preta.

A captura não precisa ser ideológica. Pode ser apenas mercantil. Hoje a rede serve a um pagador; amanhã serve a outro. O que está em disputa não é fidelidade; é fluxo.

Três linhas vermelhas

Não adianta pedir calma à multidão quando o encanamento foi desenhado para acelerar pânico. O que ajuda é estabelecer três linhas vermelhas — simples, públicas, cobradas.

Primeira: rotulagem real. Conteúdo político com uso de IA precisa ser identificado de forma padronizada.

Segunda: trilha e rastreabilidade. Quem pagou, quem executou, quem distribuiu — sem isso, a democracia vira território de “acredita quem quer”.

Terceira: resposta rápida com devido processo. Regras claras, justificativa e possibilidade de contestação.

A eleição de 2026 talvez não seja a primeira em que a inteligência artificial aparece. Mas pode ser a primeira em que ela se torna infraestrutura de guerra de percepção: uma máquina que não precisa convencer, só precisa empurrar; uma máquina que não precisa provar, só precisa saturar.

E infraestrutura não se enfrenta com gritaria. Infraestrutura se enfrenta com transparência, auditoria e norma — e com uma sociedade que reaprende a fazer a pergunta mais simples do jornalismo: de onde vem isso?

Reprodução: Brasil247